-

- I2SLAB 송인표, 이종민 학생 (지도교수: 이장원), IJCAI2024 논문 채택 NEW

- I2SLAB (지도교수: 이장원)의 송인표, 이종민(실감미디어공학과) 학생들이 연구한 논문 “ Motion-Aware Heatmap Regression for Human Pose Estimation in Videos” 이 인공지능 분야 최우수 학회 (BK IF=4) International Joint Conferences on Artificial Intelligence (IJCAI) 2024 에 게재 승인되어 8월에 발표될 예정입니다. 본 논문에서 이장원 교수 연구팀은 시간적 종속성을 고려하여 motion blur와 occlusion 속에서 사람 자세의 불확실성을 효과적으로 모델링할 수 있는 motion-aware heatmap 이라는 새로운 아이디어를 제안하였습니다. 논문의 자세한 내용은 다음과 같습니다. [논문] Inpyo Song, Jongmin Lee, Moonwook Ryu, and Jangwon Lee, “Motion-Aware Heatmap Regression for Human Pose Estimation in Videos,“ International Joint Conferences on Artificial Intelligence (IJCAI 2024), Aug. 2024. [Abstract]. We present an approach to solving 2D human pose estimation in videos. The problem of human pose estimation in videos differs from estimating human poses in static images since videos contain a lot of motion related information. Thus, we investigate how to utilize by the information of the human body movements across in a sequence of video frames for estimating human poses in videos. To do this, we introduce a novel heatmap regression method what we call motion-aware heatmap regression. Our approach computes motion vectors in joint keypoints from adjacent frames. We then design a new style of heatmap that we call Motion-Aware Heatmaps to reflect the motion uncertainty of each joint point. Unlike traditional heatmaps, our motion-aware heatmaps not only consider the current joint locations but also account how joints move over time. Furthermore, we introduce a simple yet effective framework designed to incorporate motion information into heatmap regression. We evaluate our motion-aware heatmap regression on PoseTrack(2018, 21) and Sub-JHMDB datasets. Our results validate that the proposed motion-aware heatmaps significantly improve the precision of human pose estimation in videos, particularly in challenging scenarios such as videos like sports game footage with substantial human motions.

-

- 작성일 2024-04-18

- 조회수 656

-

- 실감미디어공학과 FUN DAY - "BEER DAY" NEW

- 지난 4월 11일, 혜화역 인근의 작은 치킨집에서 실감미디어공학과 BEER DAY를 진행하였습니다. 참여 교수진과 재학생들이 모여 뜨거운 열정과 스트레스들을 잠시 내려놓고, 즐겁게 치킨과 맥주를 마시며 유대감과 소속감을 돈독히 할 수 있는 시간이었습니다. 실감미디어공학과에서는 매 학기 BEER DAY를 개최하며, 9월에 2학기 BEER DAY가 개최될 예정입니다. 그 외에 많은 FUNDAY 행사들이 기다리고 있으니 많은 기대와 참여를 부탁드립니다. 감사합니다.

-

- 작성일 2024-04-17

- 조회수 346

-

-

- 실감미디어공학과 송인표 학생 SKKU Research Matters 장려상 수상

- 이장원 교수님 I2SLab 소속 실감미디어공학과 석사과정 송인표 학생이 2023학년도 제2회 연구성과 경진대회(SKKU Research Matters)에서 장려상을 수상했습니다. 송인표 학생은 "기술의 사회적 책임을 강조하며, 시각 장애인을 비롯해 소외된 분야를 위한 인공지능 기술 연구가 활발히 이루어져야 한다는 연구 배경을 밝혔습니다." 구체적으로는 "360도 자기중심형 카메라를 사용하여 시각장애인의 일상생활 속에서 발생할 수 있는 위험 및 이상 상황을 감지하는 시각 인공지능 모델을 소개했습니다."

-

- 작성일 2024-04-03

- 조회수 971

-

- 박은일교수 - 미래의 신입 개발자에게 전하는 현직자 이야기 [42SEOUL 인터뷰]

- 안녕하세요 실감미디어공학과 사무실입니다. 박은일교수님께서 "미래의 신입 개발자에게 전하는 현직자 이야기" 라는 주제로 42SEOUL 과 인터뷰하였습니다. <인터뷰 내용> Q1. 개발자로서 성공하기 위한 핵심능력은 무엇이라고 생각하니까? 소프트웨어와 데이터는 오늘날 사회에서 가장 이제 급변하고 있는 분야 중에 하나인데요 아무래도 이제 계속해서 바뀌다 보니까 기존에 있던 기성 교육 또는 대학 교육이라던가 정형화된 교육에서는 담지 못하는 많은 부분들이 있습니다 그런 부분들을 잘 채워 나가는 능력들을 이제 문제를 정의하고 해결하는 능력이라고 생각하고 있는데요 기성 교육을 잘 닦여진 길에서 달리기를 하는 과정이라고 생각하면 누군가는 풀밭을 해치면서 걸어가야 되고 누군가 물을 건너가면서 건너가야 되기도하기 때문에 그런 과정을 통해서 문제를 정의하고 해결하는 과정도 반드시 필요하는 과정 중에 하나라고 생각합니다 왜냐면 미래 사회는 조금 더 문제들이 잘 정의되지 않고 그리고 답이 없는 케이스들이 보다 더 많이 나올 것이기 때문에 기성 교육 이외에도 문제를 해결하는 과정과 정의하는 과정들에 특화된 인재가 조금 더 필요할 거라고 생각합니다. Q2. 개발자가 향후 기술 트랜드에 대비하는 자세는 무엇이라고 생각하시나요? 더 다양하고 해답이 없는 문제들로 발달을 하고 있기 때문에 단순히 개발자가 되고 싶은 사람들에게 교수자의 입장에서 지식을 전달해 주고 습득하는 과정도 매우 중요하지만 이 지식을 전한 지식을 스스로 배울 수 있는 능력 그리고 그리고 문제를 정의할 수 있는 능력, 문제를 해결하고 동료와 함께 나아갈 수 있는 능력도 보다 중요할 거라고 생각을 하고 있습니다 Q3. 적극적으로 추천하고 싶은 학습방법이나 자료가 있나요? 오늘 날, 인터넷이나 아니면 주위에 보면 엄청나게 많은 자료들이 다 놓여져 있는데 단순히 그 자료들을 받아들이고 그냥 학습하는 것보다는 실제로 그걸 받아들이고 자기 것으로 만드는 과정들이 필요합니다. 동료와 고민을 한 후에 나만의 방법은 무엇인가? 내가 개발하기 위한 방법은 무엇인가? 나한테 잘 맞는 방법은 무엇인가?에 대해 고민하는 방법이 필요합니다 Q4. 취업후 빠르게 성장하기 위한 조언을 해주세요. 주위에 나와 비슷한 형태의 이제 문제를 해결하는 친구들 그리고 동료들로 있기 때문에 문제를 해결하는 과정이 다 이제 비슷비슷하게 수행될 때도 있고 다 동일한 목표를 따라서 달려가는 형태도 있을 겁니다. 여러분들이 산업에 나가면 그것 이외에도 실제 대학을 다니다가 개발자가 된 친구도 있을 거고 독학을 통해 개발 개발자가 된 친구 친구들도 있을 겁니다. 이런 모든 친구들과 같이 문제를 해결하는 과정을 해야 되고 해결 그 결과물에 도달을 해야 됩니다. 끊임없이 문제를 정의하고 해결하는 과정을 나는 많이 해봤다 그러니까 산업 내에서도 계속 해보겠다 이런 자세를 가지는 것이 가장 중요한 관점이라고 생각하고 있습니다 감사합니다. 강병협 드림.

-

- 작성일 2024-03-11

- 조회수 507

-

- 성균웹진534호) 좋아하는 일을 직업으로 삼다! ‘덕업일치’ 류은석 교수

-

| 소프트웨어융합대학 실감미디어공학과 류은석 교수 우리 학교 대학원 실감미디어공학과는 실감형 메타버스 ICT 기술과 문화 영상 콘텐츠 양자를 선도하는 실감미디어 전문가를 양성하기 위해 2023년 설립한 첨단분야 신설 학과다. 5대 기반 기술인 영상처리, 그래픽스, 인공지능, 플랫폼, 인터랙션 기술과 5대 응용기술인 문화콘텐츠, 트랜스미디어, 디지털 휴먼 및 치료제, NFT, XR 스튜디오 기술에 특화된 커리큘럼을 운영하고 있다. 해외 대학, 연구소, 전문 기업과의 국제 교류 및 산학 협력 네트워크 구축을 통해 글로벌 전문가 양성에도 힘쓰고 있다. 류은석 교수는 컴퓨터교육과 교수이면서 대학원 실감미디어공학과의 학과장 및 과학기술정보통신부의 메타버스 융합대학원 국책과제 사업단장이다. 선도적인 연구와 전문적인 글로벌 인재 양성에 매진하고 있는 류은석 교수의 이야기를 들어보자. - 최근 진행한 연구와 그 성과는. 제가 이끄는 멀티미디어 컴퓨팅 시스템 연구실은 차세대 가상현실 비디오 압축 국제 표준 기술(MIV)을 연구하고 국제 표준화를 시도합니다. 최근에는 ISO/IEC 국제 표준 조직 MPEG에서 우리 연구실이 취득한 테스트 영상을 국제 표준 실험의 필수 조건에 포함하는 성과를 얻었습니다. 작년 초 카네기 멜런 대학교에서 본 연구원들이 ‘연구를 위한 연구’보다는 실제 로봇을 이용한 실용적인 연구에 관심을 가지는 모습이 인상적이었습니다. 우리 연구실도 당장의 논문이나 실적을 위한 연구보다는 진정으로 의미 있는 일을 해보자는 목표를 가지고 노력한 결과 좋은 결실을 얻을 수 있었습니다. 요즘에는 여러 대의 이동형 로봇에 카메라를 달아서 공간 전체를 Volumetric Video로 압축하는 기술(3차원 공간 전체를 부호화하는 기술)을 개발하고 있습니다. 제가 어렸을 때 로봇을 참 좋아했는데, 내 전공과 로봇이 융합된 연구를 하니 일이 즐겁습니다. 요샛말로 ‘덕업일치’를 이루는 연구인 것 같습니다. - 가장 기억에 남는 연구가 있다면. 조지아공과대학교에서 Research Scientist로 있을 때

라는 프로젝트를 진행한 적이 있습니다. 그 당시의 제가 감당하기에는 벅찬 업무였습니다. 프로젝트 도중 수많은 난관을 마주해야 했고 밤을 새워가며 일을 했습니다. 그렇게 전 세계 다양한 연구자들의 글을 살펴보고 메일로 연락을 주고받으며 연구하던 중 프랑스의 한 연구자가 Open Source 관련된 기술을 개발하고 있다는 소식을 접했습니다. 그 연구원에게 도움을 받아 연구를 이어간 결과 나는 프로젝트에서 목표했던 바를 이룰 수 있었습니다. 그때 ‘나 개인은 부족함이 있어도 세상의 뛰어난 사람들과 협력한다면 못 이룰 일이 없겠다’는 걸 깨달았습니다. 연구 활동에서 개방된 기술 교류는 정말 중요합니다. - 연구실을 소개해주세요. 연구실에서 사람을 뽑을 때 중요하게 생각하는 부분이 있다면. 우리 연구실은 Greedy 하기보다는 재밌는 연구를 하며 사회에 기여하자는 목표를 가지고 있습니다. 일이 즐거워야 하다 보니 연구원을 뽑을 때도 ‘이 사람이 컴퓨터를 사랑하는지, 기술에 대한 진리 탐구의 열정이 있는지, 인성이 좋은지’ 등을 살펴봅니다. 자기가 좋아서 그 일을 하는 사람이 재능을 가진 사람보다 일을 더 잘할 수 있다고 생각합니다. - 연구자로서 어려움이나 고민은. 컴퓨터과학 분야에서 대학원생들과 연구실을 꾸리고 함께 연구를 진행하려면 국내외 프로젝트를 수주해야 합니다. 문제는 프로젝트를 따내고 운영하는 과정에서 생기는 수많은 행정 업무를 처리하고 대학원생들을 관리하는 일이 업무적으로 큰 부담이 된다는 점입니다. 함께 연구할 대학원생들을 충분히 구하지 못했을 때, 존경하는 교수님이 최고대학을 그만두고 기업으로 옮기셨을 때 등 여러 인간적인 고충을 겪었던 기억이 있습니다. 어떤 면에서는 연구보다 행정, 조직 환경이 연구자를 지치게 합니다. 현재 내가 속한 실감미디어공학과의 과제 지원 조직인 지능형 멀티미디어 연구센터를 계속 키워서 소속된 교수님들의 행정 업무 부담을 덜어드리고 싶습니다. 연구자로서 self-motivated 상태를 유지하기도 참 어렵습니다. 그래서 평소에 시간이 되면 OTT 서비스를 통해 IT기술에 관한 다큐멘터리나 영화, 드라마를 봅니다. 같은 영화를 보면 가상현실 기술 연구에 대한 열정이 한 달은 더 생기고 AlphaGo나 NASA의 달 탐험에 관한 다큐멘터리를 보면 갑자기 Lab Meeting을 소집하는 열정이 깨어납니다. 그리고 무엇보다 좌절을 극복할 힘을 주는 가장 큰 축복은 사랑하는 아이들 호원이와 이안이를 포함한 나의 가족입니다. - 연구자로서 목표가 있다면. 기술 자체를 좋아하는, 조금은 Geek스러운 연구자로 살아가고 싶습니다. 이번 생에 다른 부분은 조금 내려놓더라도 내가 좋아하는 컴퓨터 기술에 집중하여 먼 훗날 인생의 마지막까지 연구를 이어가고 싶습니다. - 이야기를 들어보니 교수님의 학부생 시절이 궁금합니다. 대학생 때를 회상해 본다면. 기본적으로 컴퓨터를 즐겨 했습니다. 엉뚱한 장난을 좋아해서 해킹도 해보다가 일이 터지기도 하고. 아무튼 즐거운 대학 생활을 보냈습니다. 당시 전기전자연구회라는 교내 동아리에서 CPU와 RAM, ROM을 래핑 선으로 납땜해서 이으며 밤을 새운 적이 있습니다. 그때 창밖에 첫눈이 내리는 모습을 보며 다른 후배 녀석과 ‘우린 왜 이렇게 살지?’하며 뭉클해 했던 기억이 있습니다. 이상하게 그때가 기억에 오래 남습니다. 요즘에는 온라인으로도 각종 최신 기술을 접할 수 있습니다. 기술 습득만을 놓고 생각해 보면 대학의 의미가 작아지고 있습니다. 하지만 대학에서의 동아리 활동과 취미생활 등 열정에 미쳐보는 시간만큼은 그 가치가 줄어들지 않을 것으로 생각합니다. - 마지막으로 우리 학교 학우들에게 한마디. 자신이 현재 처해있는 상황을 냉정하게 살펴보고 도약하기 위해 끊임없이 노력하기를 바랍니다. 성균관대학교 자체는 다른 경쟁 대학들을 이기기 어려울 수 있지만 이 글을 보고 노력할 성균관대학교 학생 개인은 최고의 대학 학생들의 평균보다 더 잘 될 수 있습니다. 정점에 설 그날까지 staying motivated. 취재 이다윤 기자 편집 장수연 기자 -

- 작성일 2024-03-04

- 조회수 466

-

-

-

- 2023 제 1회 실감미디어공학과 성과교류회 성료

- 지난 12/22, 2023 제 1회 실감미디어공학과 성과교류회가 성료되었습니다. 행사는 국제관 9B217에서 류은석 학과장과 김장현 학부장의 인사말로 시작하였습니다. 류은석 학과장이 제작한 영상을 통해 한 해를 뒤돌아보는 시간을 가졌고, 메타버스융합대학원 사업과 실감미디어공학과의 2023년의 성과와 내년 계획 등을 발표하였습니다. 지능형멀티미디어연구센터에서는 내년 실적목표에 대해 공유하였고, 실적의 제출방법, 로고제작 및 사용, 실감미디어 세미나 등 학과 운영과 관련하여 교원들과 학생들에게 안내하였습니다. Outstanding Faculty Awards 를 통해 올해에 학과에 사업에 크게 기여한 교원과 스탭을 시상하였고, Gold 는 박은일 교수님이 수상하였습니다. 2부 행사는 600주년 기념관 Faculty 식당에서 식사와 함께 행운권 추첨이 진행되었습니다. 맛있는 식사와 행사를 통해 교원들과 학생들간의 즐거운 시간을 보낼 수 있었고, 소속감과 유대감을 함양할 수 있는 시간이었습니다. 2024 성과교류회는 학생들의 연구성과 발표와 외부기업 초청 등을 통해 더욱 풍성하고 내실 있게 진행될 예정입니다. 2024년에도 실감미디어공학과(메타버스융합 대학원사업)에서 더 많은 성과를 낼 것을 기대하겠습니다. 행사를 준비해주신 류은석학과장(사업단장)님과 연구센터의 직원들에게 큰 감사를 드리며, 2023 성과교류회 소식 전달을 마칩니다. 감사합니다.

-

- 작성일 2024-01-04

- 조회수 894

-

- [성균웹진530호]현실과 미디어의 벽을 허물다 실감미디어공학과

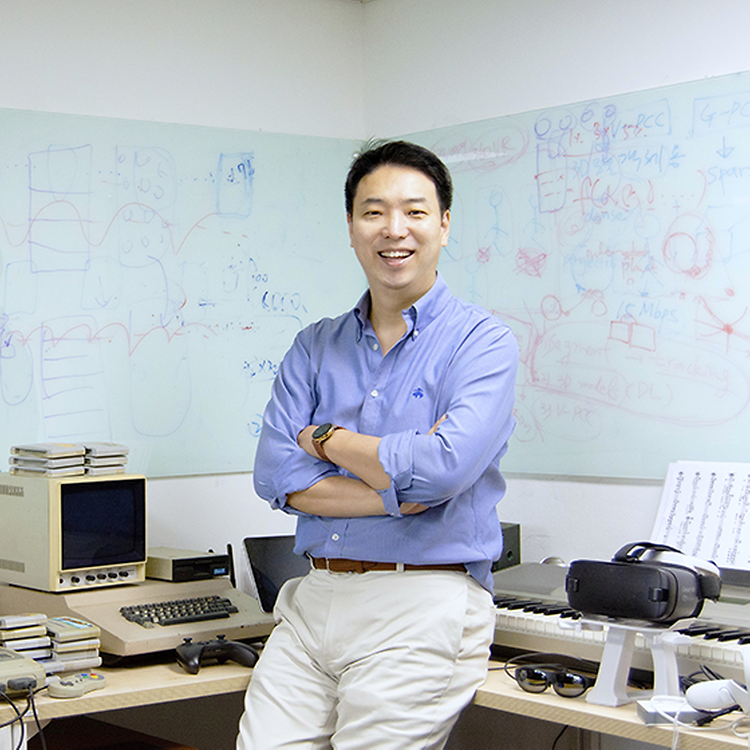

- 미디어 콘텐츠를 단지 보는 것을 넘어 그 속으로 들어가 경험할 수 있는 것, 이는 최근 각광받는 실감형 콘텐츠를 한 마디로 설명한 것이다. 이는 앞으로 미디어 산업이 나아갈 방향이자 미디어 시장의 흐름을 뒤바꿀 중요한 키워드이다. 마찬가지로 이를 구현할 수 있는 기술력 또한 차세대 산업을 선도하는 데에 있어 특히 중요하다. 우리 대학은 이러한 실감미디어콘텐츠 구현 역량을 지닌 미래의 글로벌 인재를 양성하고자 2023년 8월 실감미디어공학과를 신설했다. 실감미디어공학과는 소프트웨어융합대학 소속의 대학원 과정 신설학과로, 최근 주목받는 실감형 콘텐츠의 기술적 측면, 콘텐츠의 내용적 측면 모두를 다루는 커리큘럼을 제공한다. 이번 커버스토리에서는 실감미디어공학과의 신임 교수인 이장원 교수와 홍성은 교수를 만나 실감미디어공학과에 대해 이모저모 알아보는 시간을 가졌다. 두 교수의 이야기를 통해 실감미디어공학과에 깊이 들어가 보자. | 만나서 반갑습니다. 자기소개 부탁드립니다. 이장원 교수(오른쪽 사진) | 안녕하세요. 2023학년도 1학기에 새로 부임한 실감미디어공학과 및 컴퓨터공학과의 신임 교원, 이장원입니다. 성균관대 부임 이전에는 한국항공대학교에서 3년간 연구와 강의를 진행했습니다. 그전에는 미국 인디애나대학교에서 박사학위를 받고, Alarm.com과 NASA JPL에서 다양한 프로젝트를 수행하며 즐거운 연구 경험을 쌓았습니다. 이전에는 성균관대학교에서 학부와 석사 과정을 마치고 삼성전자에서 6년간 SW Engineer로 일하기도 했습니다. 만나서 정말 반갑습니다. 홍성은 교수 | 안녕하세요. 저는 2023학년도 2학기에 실감미디어공학과에 새로 부임한 홍성은입니다. 저는 현재 AI & Media (AIM) Lab을 이끌고 있으며, 저희 연구실은 시각 인지 및 생성과 관련된 인공지능 연구와 이미지, 텍스트, 음성 등 다양한 데이터를 융합하여 추론하는 인공지능 연구에 중점을 두고 있습니다. 개인적으로는 다양한 미디어 매체에 깊은 관심이 있으며 특히 필름 카메라 사진에 열정을 쏟아 사진 전시회를 여는 등 사진과 영상 작업을 매우 좋아합니다. | 교수님의 대표적인 연구 활동 및 성과 소개 부탁드립니다. 이장원 교수 | 제 연구 분야는 Computer Vision 및 Robotics입니다. 구체적으로 “Learning Activities from Human Demonstration Videos”라는 주제로 박사 학위를 받았는데요. 비디오와 같은 데이터로부터 사람의 행동을 이해 및 분석하고 이를 바탕으로 사람과 보다 자연스럽게 상호작용 할 수 있는 지능시스템을 개발하는 데 관심이 있습니다. 관련한 연구 주제로 비디오 데이터로부터 인간의 행동을 모방하는 방법을 연구하여 2017년도에 컴퓨터 비전 및 패턴인식 분야 세계 최고 권위 학회인 CVPR에서 열린 “Deep Learning for Robotic Vision” Workshop에서 최우수 논문상을 받기도 했습니다. 홍성은 교수(아래 사진) | 지난 3년간 저는 주로 두 가지 연구 분야에 집중해 왔습니다. 첫 번째 연구 분야는 인공지능이 다양한 종류의 데이터를 융합하여 환경을 인식하고 추론하는 방법에 관한 것입니다. 예를 들어, 우리가 일상에서 흔히 접할 수 있는 RGB 영상 외에도 깊이나 열화상 영상, 언어 및 음성 정보 등 다양한 종류의 데이터를 상호 보완적으로 결합하는 방법을 연구하고 있습니다. 최근에는 삼성전자 미래기술사업의 지원을 받아, 로봇이 인간처럼 물체를 조작하기 위해 시각과 촉각 정보를 효율적으로 융합하는 연구를 진행했습니다. 두 번째 연구 분야는 환경 변화에 적응가능한 인공지능 모델 개발입니다. 이는 메타버스 내에서의 휴먼 모델링이나, 시뮬레이션에서 학습된 모델을 실제 환경에 적용하는 분야에 활용되는 연구로, 실제와 가상의 경계를 허무는 기술 발전에 기여하고 있습니다. | 실감미디어공학과에 대한 소개 부탁드립니다. 어떤 걸 배우는 학과인가요? 실감미디어공학과는 소프트웨어융합대학 소속으로서 인문사회과학캠퍼스에 있으며 2023년에 신설되었습니다. 실감미디어공학과에서는 영상처리, 그래픽스, 인공지능, 플랫폼, 인터랙션 등의 기술적 분야뿐만 아니라, 콘텐츠, 인터랙션, 문화 기술의 융합에 관한 학문을 배웁니다. 이를 통해 실감형 메타버스와 ICT기술, 문화 및 영상 콘텐츠 기술을 아우르는 글로벌 리딩 전문가를 양성하는 것을 목표로 합니다. | ‘실감미디어’라는 단어가 생소한데요, 실감미디어학과에서 배우는 ‘실감미디어’가 정확히 무엇인가요? 실감미디어의 의미는 이와 가장 관련이 높은 단어인 XR(Extended Reality)를 생각하시면 이해가 쉬우실 겁니다. 이는 가상현실(VR), 증강현실(AR), 혼합현실(MR) 등을 통합하는 개념으로, 현실과 가상의 경계를 허물어 사용자가 보다 콘텐츠에 현실감 있게 몰입할 수 있도록 도와주는 미디어 기술을 의미합니다. 이러한 실감미디어 기술은 사용자에게 실시간 상호작용과 시각, 청각, 촉각을 활용한 현실감 있는 경험을 제공하며 교육, 엔터테인먼트, 의료 등 다양한 분야에서 응용될 수 있습니다. | 실감미디어공학과의 트랙은 어떻게 되나요? 크게 메타버스 5대 핵심 기반 기술(인공지능/영상처리/그래픽스/인터랙션/플랫폼)을 다루는 실감미디어테크 트랙과 5대 응용 기술(문화콘텐츠/트랜스미디어/디지털휴먼 및 치료제/NFT/XR 스튜디오)을 배우는 실감미디어콘텐츠 트랙으로 구분됩니다. 학과 전체 커리큘럼은 CS/EE 전공 기반 기술과 콘텐츠 관련 기술이 약 7:3 비율로 구성되며, 특히 인공지능, 컴퓨터비전, 그래픽스, 영상처리 관련 과목들이 많이 개설됩니다. ▲ 실감미디어공학과 트랙 | 실감미디어공학과에서 배우는 실감미디어기술, 콘텐츠기술의 전망에 대해 어떻게 생각하시나요? 실감미디어공학과에서 배우는 실감미디어기술과 콘텐츠기술의 전망은 매우 밝다고 생각합니다. 불과 몇 해 전과 다르게 ‘메타버스’라는 단어의 사용 및 노출빈도가 많이 줄어들고 관심이 시들어가고 있는데요, 하지만 이와 달리 XR로 대표되는 실감미디어기술들은 계속해서 발전하고 있으며, 관련 컨텐츠 또한 계속 생산되고 있습니다. 이는 실감미디어기술이 사용자에게 실시간 상호작용과 깊은 몰입감을 제공하며 새로운 경험과 가치를 창출할 수 있기 때문이라고 생각합니다. 콘텐츠 기술은 디지털 스토리텔링, 인터랙티브 미디어, 데이터 시각화 등을 포함하여 정보와 경험을 전달하는 새로운 방법을 제공합니다. 따라서 실감미디어기술은 미디어 산업뿐만 아니라 마케팅, 게임, 엔터테인먼트, 교육, 의료, 로봇 등 다양한 분야에서 중요한 역할을 하게 될 것으로 전망합니다. | 실감미디어공학과는 대학원 과정으로 알고 있는데요, 실감미디어공학과 진학을 희망하는 학생들이 갖추어야 할 자질은 어떤 것이 있을까요? 기술적 기반을 강조하는 '테크 트랙'과 응용 기술에 초점을 맞춘 '콘텐츠 트랙' 모두 공통적으로 프로그래밍 기초 지식과 경험이 중요합니다. 특히 컴퓨터비전, 그래픽스, 인공지능과 같은 학과에서 집중하고 있는 분야에서는 확률 및 통계, 선형대수, 미적분과 같은 수학적 지식도 선행되어야 합니다. 학과의 특성을 고려하면, 미디어에 대한 관심과 열정을 가진 학생들은 더욱더 큰 동기 부여를 받아 학업에 더욱 집중할 수 있을 것으로 보입니다. | 실감미디어공학과 신임 교수로서 어떤 교수가 되고 싶으신지 앞으로의 계획이나 목표가 궁금합니다. 이장원 교수 | 신임 교원으로서 제 강점은 다양한 국내외 연구 경험이라고 생각합니다. 저는 이를 기반으로 학생들에게 실용적이고 창의적인 교육을 제공하고 싶습니다. 특히, 국내외 다양한 네트워크를 이용하여 실감미디어공학과 학생들에게 국제적인 연구 프로젝트 참여와 경험 기회를 제공하고자 합니다. 연구 영역에서는 더 자연스럽고 인간다운 상호작용을 갖는 인공지능 시스템 개발을 통해 사회에 긍정적인 영향을 끼치고자 합니다. 홍성은 교수 | 신임 교수로서 제 목표는 학생들이 급변하는 현대 기술 사회에서 자신만의 전문성과 빠른 적응력을 개발할 수 있도록 지원하는 것입니다. 특히, 올해 인공지능 분야는 기술적으로 중대한 전환점을 맞이했습니다. 저뿐만 아니라 학생들이 이러한 변화의 소용돌이에 휩쓸리거나 주변을 맴돌지 않고, 변화의 파도를 직접 타며 자신만의 전문성을 강화하는 것을 목표로 삼고 있습니다. 이를 위해, 제가 쌓아온 산업계 경험을 바탕으로 학생들이 실제 산업 현장과 학계에서 마주치는 다양한 도전과 난관에 대비할 수 있도록 실질적인 지도와 멘토링을 제공할 계획입니다. 연구 기회와 자원을 적극적으로 지원하여 학생들이 혁신적인 연구를 수행하고, 필요한 고급 기술 및 해결 방안을 개발하도록 할 것입니다. | 마지막으로 실감미디어공학과 진학을 꿈꾸는 학생들에게 한 마디 부탁드립니다. 이장원 교수 | Hoxy, XR 기술에 관심이 있으신가요? 인공지능을 비롯한 기술의 진보에 대한 열정이 있나요? Apple의 최신 제품인 Vision Pro가 여러분의 호기심을 자극했나요? 실감미디어 기술을 중심으로 새로운 사용자 경험을 만들 수 있다고 생각하시나요? 만약 여러분이 이 모든 질문에 긍정적으로 답했다면, 실감미디어공학과가 여러분에게 최고의 경험을 제공할 장소일 수 있습니다. 홍성은 교수 | ‘Connecting the dots’라는 제가 좋아하는 개념에 대해 이야기하고 싶습니다. 인생은 다양한 선택과 경험으로 이루어진 '점들’로 채워져 있으며, 이러한 점들 사이의 ‘연결성’이 매우 중요하다고 생각합니다. 일부 점들은 현재에는 분명한 의미를 지니지 않아 보일 수 있지만, 예측 불가능한 미래에서는 중요한 발전의 출발점으로 연결될 수 있습니다. 실감미디어공학과 진학을 희망하는 학생들은 준비 과정에서 실감미디어와 관련된 다양한 경험을 적극적으로 쌓으며 자신만의 '점들'을 채워 나가고, 이러한 점들 간의 '연결성'을 끊임없이 탐색해 보았으면 합니다.

-

- 작성일 2024-01-03

- 조회수 606

발전기금

발전기금